Ο πόλεμος στη Μέση Ανατολή κλιμακώθηκε τη Δευτέρα (2/3), καθώς το Ισραήλ έπληξε στόχους στον Λίβανο και το Ιράν έπληξε με επίθεση drone βρετανική αεροπορική βάση στην Κύπρο.

Η Ελλάδα έστειλε φρεγάτες και μαχητικά αεροσκάφη μετά την επίθεση με drone και άλλες παραβιάσεις από μη επανδρωμένα αεροσκάφη ενώ τρία αμερικανικά αεροσκάφη καταρρίφθηκαν κατά λάθος από την αεράμυνα του Κουβέιτ.

Την ίδια στιγμή, μέσα στο γενικότερο χάος που επικρατεί στη Μέση Ανατολή, η Ευρωπαϊκή Ένωση προσπαθεί εσπευσμένα να αντιδράσει σε μια ταχέως επεκτεινόμενη σύγκρουση στην οποία διαθέτει πολύ περιορισμένη επιρροή.

Ας επιστρέψουμε, όμως, στην αρχή των πρόσφατων επιθέσεων και σε ένα ζήτημα που μας απασχολεί έντονα τα τελευταία χρόνια. Μάλιστα, με κάποιο τρόπο, συνδέεται άμεσα με την επικαιρότητα: τη χρήση της τεχνητής νοημοσύνης.

Το AI στον πόλεμο και η οι αντιφάσεις

Ο αμερικανικός στρατός φέρεται να χρησιμοποίησε το Claude, το μοντέλο τεχνητής νοημοσύνης της Anthropic, για την επίθεσή του στο Ιράν, παρά την απόφαση του Ντόναλντ Τραμπ. Με λίγα λόγια, χρησιμοποιήθηκε η «απαγορευμένη» τεχνολογία η οποία, μάλιστα, «ακυρώθηκε» λίγες ώρες πριν την επίθεση.

Όπως δήλωσε ο πρόεδρος των ΗΠΑ. ο αμερικανικός στρατός διακόπτει κάθε σχέση με την εταιρεία και τα εργαλεία τεχνητής νοημοσύνης της. Λίγες ώρες αργότερα, με τα εργαλεία της Anthropic, πραγματοποιήθηκαν οι πρώτες εκρήξεις.

Η χρήση του Claude κατά τον μαζικό κοινό βομβαρδισμό ΗΠΑ-Ισραήλ στο Ιράν που ξεκίνησε το Σάββατο (28/2) δείχνει και την την πολυπλοκότητα της απόσυρσης ισχυρών εργαλείων τεχνητής νοημοσύνης από τις αποστολές του αμερικανικού στρατού, όταν η τεχνολογία είναι ήδη βαθιά ενσωματωμένη στις επιχειρήσεις.

Για ποιο λόγο χρησιμοποιήθηκε το Claude

H στρατιωτική διοίκηση των ΗΠΑ χρησιμοποίησε τα εργαλεία για σκοπό να συλλέξει πληροφορίες, καθώς και για να βοηθήσει στην επιλογή στόχων και στη διεξαγωγή προσομοιώσεων πεδίου μάχης.

Την Παρασκευή (27/2), μόλις ώρες πριν αρχίσει η επίθεση στο Ιράν, ο Τραμπ διέταξε όλες τις ομοσπονδιακές υπηρεσίες να σταματήσουν αμέσως τη χρήση του Claude.

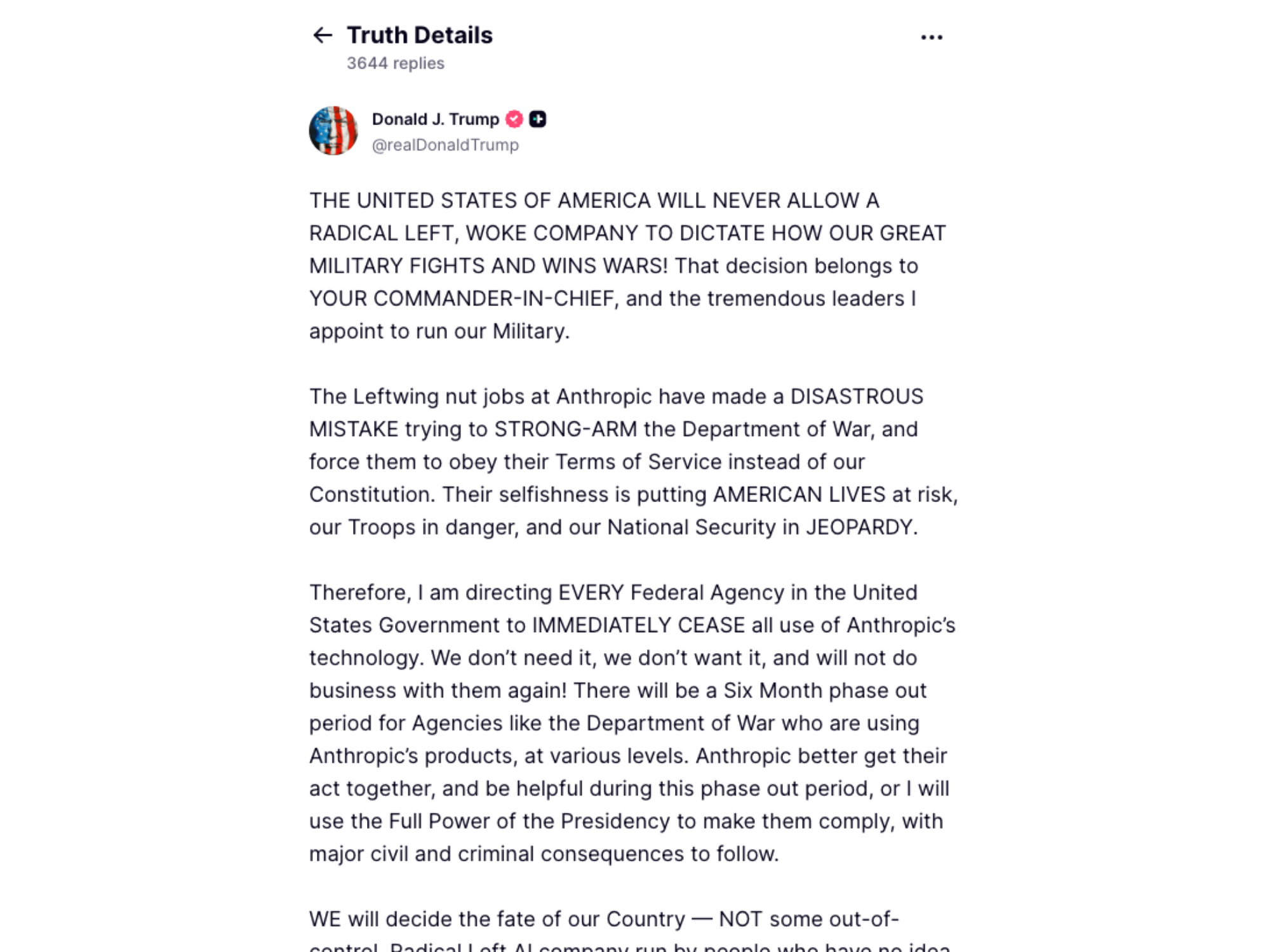

Κατήγγειλε, μάλιστα, την Anthropic στο Truth Social ως «μια ριζοσπαστική αριστερή εταιρεία τεχνητής νοημοσύνης που διοικείται από ανθρώπους που δεν έχουν ιδέα για το τι συμβαίνει στον πραγματικό κόσμο».

Σε μια εκτενή ανάρτηση στο X την Παρασκευή, ο υπουργός Άμυνας Πιτ Χέγκσεθ κατηγόρησε την Anthropic για «αλαζονεία και προδοσία», προσθέτοντας ότι «οι Αμερικανοί μαχητές δεν θα κρατούνται ποτέ όμηροι από τις ιδεολογικές ιδιοτροπίες της Big Tech».

Ο Χέγκσεθ ζήτησε πλήρη και απεριόριστη πρόσβαση σε όλα τα μοντέλα τεχνητής νοημοσύνης της Anthropic για κάθε νόμιμο σκοπό.

Ωστόσο, ο υπουργός Άμυνας αναγνώρισε επίσης τη δυσκολία της ταχείας αποσύνδεσης των στρατιωτικών συστημάτων από το εργαλείο τεχνητής νοημοσύνης, δεδομένου του πόσο ευρέως έχει χρησιμοποιηθεί. Δήλωσε ότι η Anthropic θα συνεχίσει να παρέχει υπηρεσίες «για περίοδο όχι μεγαλύτερη των έξι μηνών ώστε να επιτραπεί μια ομαλή μετάβαση σε μια καλύτερη και πιο πατριωτική υπηρεσία».

Μετά τη ρήξη με την Anthropic, η ανταγωνίστρια εταιρεία OpenAI κάλυψε το κενό. Ο διευθύνων σύμβουλος της OpenAI, Σαμ Άλτμαν, δήλωσε ότι έχει επιτευχθεί συμφωνία με το Πεντάγωνο για τη χρήση των εργαλείων της εταιρείας, τα οποία περιλαμβάνουν το ChatGPT.

Anthropic vs Πεντάγωνο

REUTERS/Dado Ruvic

Το μοντέλο Claude χρησιμοποιήθηκε στην επιχείρηση του Ιανουαρίου για τη σύλληψη του πρώην προέδρου της Βενεζουέλας Νικολάς Μαδούρο και λίγες μέρες μετά έγινε ξεκάθαρο πως η Anthropic βρίσκεται σε αντιπαράθεση με το Υπουργείο Άμυνας των ΗΠΑ, το οποίο της έδωσε το καλοκαίρι του 2025 ένα συμβόλαιο ύψους έως 200 εκατ. δολαρίων.

Η ρήξη, όμως, ήταν εκεί, πριν καν οι Ντοναλντ Τραμπ και Πιτ Χέγκσεθ την κάνουν ευρέως γνωστή: Όταν η Anthropic επιδίωκε επενδυτές για τον τελευταίο γύρο χρηματοδότησης ύψους 30 δισ. δολαρίων, απευθύνθηκε στην 1789 Capital, μια επενδυτική εταιρεία προσκείμενη στον Τραμπ, όπου ένας από τους γιους του προέδρου είναι συνέταιρος.

Αφού εξέτασε μια επένδυση ύψους εκατοντάδων εκατομμυρίων δολαρίων, η 1789 αποφάσισε τελικά να μην προχωρήσει, επικαλούμενη ιδεολογικούς λόγους. Μεταξύ των ανησυχιών της ήταν το ιστορικό ηγετικών στελεχών της Anthropic που είχαν επικρίνει τον Ντόναλντ Τραμπ, η παρουσία αρκετών πρώην αξιωματούχων της κυβέρνησης του Τζο Μπάιντεν στο δυναμικό της, καθώς και η πίεση που ασκεί για ρύθμιση της τεχνητής νοημοσύνης.

Και ρύθμιση αυτή είναι στην ουσία ο λόγος που οι δύο πλευρές, σταδιακά, θα πάρουν «διαζύγιο». Ο Πιτ Χέγκσεθ, άλλωστε, έχει χαρακτηρίσει τις «woke» τεχνολογικές εταιρείες «βάρος» και αντιμετωπίζει κάθε περιορισμό, δηλαδή τις ρυθμίσεις που ζητούν, ως εμπόδιο στη στρατιωτική αποτελεσματικότητα.

«Το έθνος μας απαιτεί οι εταίροι μας να είναι πρόθυμοι να βοηθήσουν τους πολεμιστές μας να νικήσουν σε κάθε μάχη. Πρόκειται για τα στρατεύματά μας και την ασφάλεια του αμερικανικού λαού», είχε δήλωσει ο εκπρόσωπος του Πενταγώνου Σον Παρνέλ.

Το Πεντάγωνο επιθυμεί να μπορεί να χρησιμοποιεί την Anthropic και άλλα εργαλεία τεχνητής νοημοσύνης για κάθε νόμιμο σκοπό. Η Anthropic, από την άλλη, δεν θέλει η τεχνολογία της να χρησιμοποιείται σε επιχειρήσεις όπως η εγχώρια παρακολούθηση και θανατηφόρες δραστηριότητες.

Ανταγωνιστές όπως η OpenAI, η Google και η xAI έχουν συμφωνήσει να επιτρέψουν τη χρήση των μοντέλων τους σε κάθε νόμιμη περίπτωση χρήσης -προτεραιότητα για το Πεντάγωνο. Η Anthropic, όμως, θέλει να διαφοροποιηθεί από τον βασικό της ανταγωνιστή, την OpenAI. Και κάπως έτσι, άνοιξε ο δρόμος για τη συνεργασία του Πενταγώνου με την εταιρεία του Σαμ Άλτμαν.

Τι υποστηρίζει η OpenAI

REUTERS/Bhawika Chhabra

Στην επίσημη ανακοίνωσή της, η OpenAI ξεκαθαρίζει τους λόγους που προχωράει το deal με το υπουργείο Άμυνας των ΗΠΑ και σχολιάζει διακρτικά τις εξελίξεις με την Anthropic.

Διαβάζουμε, μεταξύ άλλων: «Πιστεύουμε ότι ο αμερικανικός στρατός χρειάζεται οπωσδήποτε ισχυρά μοντέλα τεχνητής νοημοσύνης για να υποστηρίξουν την αποστολή του, ιδιαίτερα απέναντι στις αυξανόμενες απειλές από πιθανούς αντιπάλους που ενσωματώνουν όλο και περισσότερο τεχνολογίες ΤΝ στα συστήματά τους.

Αρχικά δεν προχωρήσαμε σε σύμβαση για διαβαθμισμένη ανάπτυξη, καθώς δεν θεωρούσαμε ότι οι δικλίδες ασφαλείας και τα συστήματά μας ήταν έτοιμα. Έκτοτε εργαζόμαστε εντατικά ώστε μια διαβαθμισμένη ανάπτυξη να μπορεί να πραγματοποιηθεί με εγγυήσεις που διασφαλίζουν ότι δεν θα παραβιαστούν οι «κόκκινες γραμμές».

Ήμασταν -και παραμένουμε- απρόθυμοι να αφαιρέσουμε βασικές τεχνικές δικλίδες ασφαλείας προκειμένου να βελτιώσουμε την απόδοση σε έργα εθνικής ασφάλειας. Δεν θεωρούμε ότι αυτή είναι η σωστή προσέγγιση για την υποστήριξη του αμερικανικού στρατού.

Δεύτερον, θέλαμε επίσης να αποκλιμακώσουμε την κατάσταση μεταξύ του Υπουργείου Άμυνας (DoD) και των αμερικανικών εργαστηρίων τεχνητής νοημοσύνης. Ένα θετικό μέλλον θα απαιτήσει ουσιαστική και βαθιά συνεργασία μεταξύ της κυβέρνησης και των εργαστηρίων ΤΝ.

Στο πλαίσιο της συμφωνίας μας, ζητήσαμε οι ίδιοι όροι να είναι διαθέσιμοι σε όλα τα εργαστήρια ΤΝ και συγκεκριμένα η κυβέρνηση να επιδιώξει την επίλυση των ζητημάτων με την Anthropic· η παρούσα κατάσταση δεν αποτελεί καλό ξεκίνημα για αυτή τη νέα φάση συνεργασίας μεταξύ κυβέρνησης και εργαστηρίων ΤΝ.

Στην ερώτηση για το πώς η OpenAI κατάφερε να καταλήξει σε συμφωνία ενώ η Anthropic δεν μπόρεσε, η εταιρεία κρατάει -όσο μπορεί- τις αποστάσες της.

«Με βάση όσα γνωρίζουμε, πιστεύουμε ότι η σύμβασή μας παρέχει ισχυρότερες εγγυήσεις και πιο υπεύθυνες δικλίδες ασφαλείας από προηγούμενες συμφωνίες, συμπεριλαμβανομένης της αρχικής σύμβασης της Anthropic. Θεωρούμε ότι οι “κόκκινες γραμμές” μας είναι πιο εφαρμόσιμες σε αυτή την περίπτωση.

Δεν γνωρίζουμε γιατί η Anthropic δεν μπόρεσε να καταλήξει σε αυτή τη συμφωνία και ελπίζουμε ότι τόσο εκείνη όσο και περισσότερα εργαστήρια θα την εξετάσουν».